6주차 미숑~ Chapter 04 Ch.04(04-2) KerasNLP 또는 허깅페이스 BERT 모델로 영화 리뷰 감성 분석 후 결과 캡처하기

| 6주차 (8/11 ~ 8/17) |

Chapter 04 | Ch.04(04-2) KerasNLP 또는 허깅페이스 BERT 모델로 영화 리뷰 감성 분석 후 결과 캡처하기 | Ch.04(04-2) 감성 분석에 사용된 토큰화 과정 살펴보고 입력과 출력 비교해 보기 |

마지막도 지각이지만 안하는것보다 낫다!! 라는 신념으로 새벽에 깨서 인증.

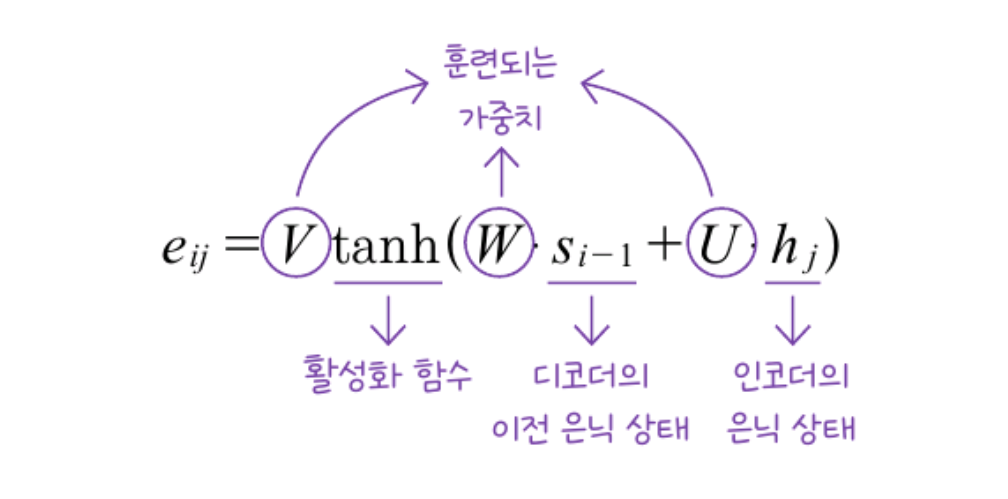

순환신경망의 컨텍스트벡터부터 살펴보쟈.

타임스텝이라는 개념

이런 설명 본받아야겠다!!

이부분 설명이 진짜 대박

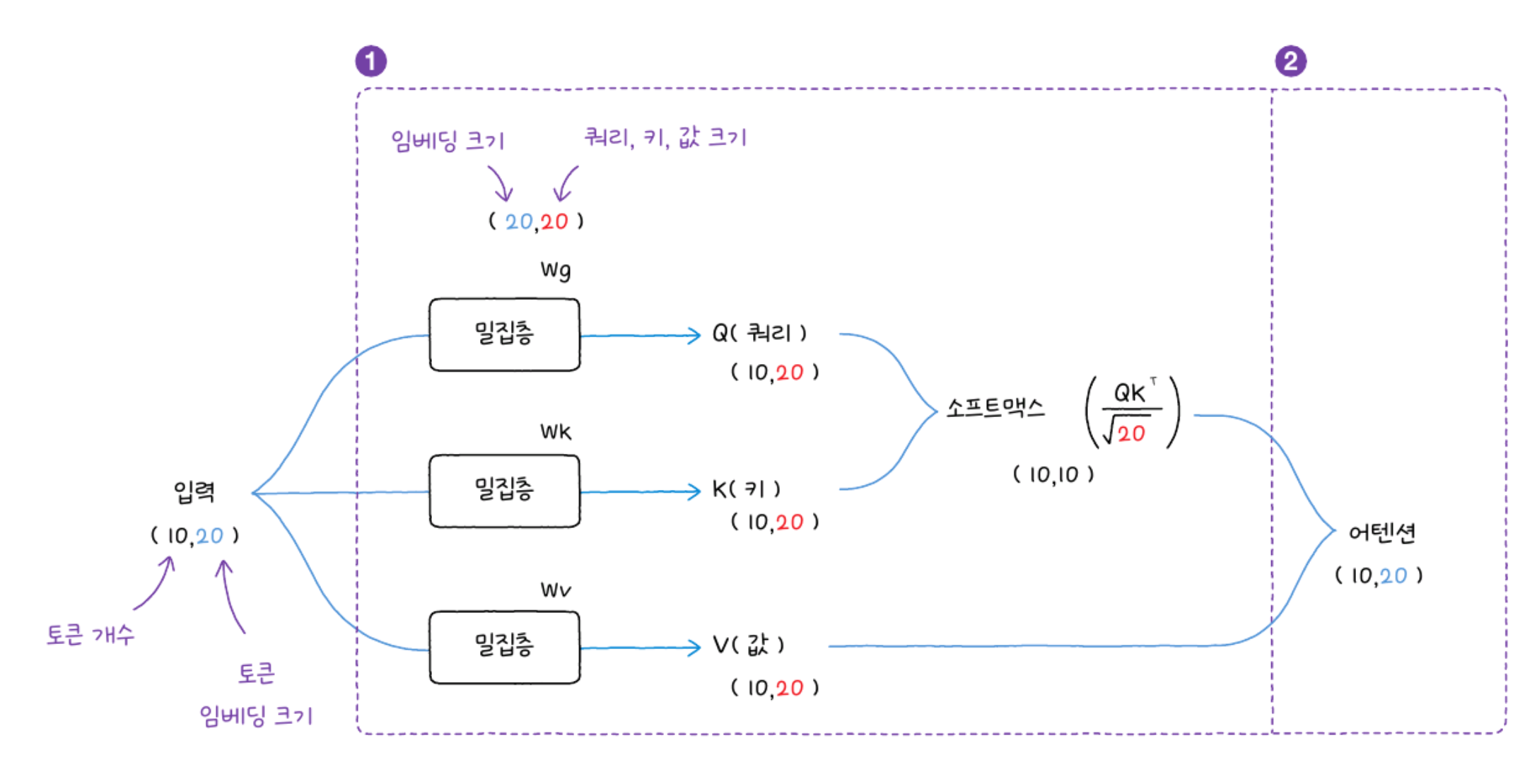

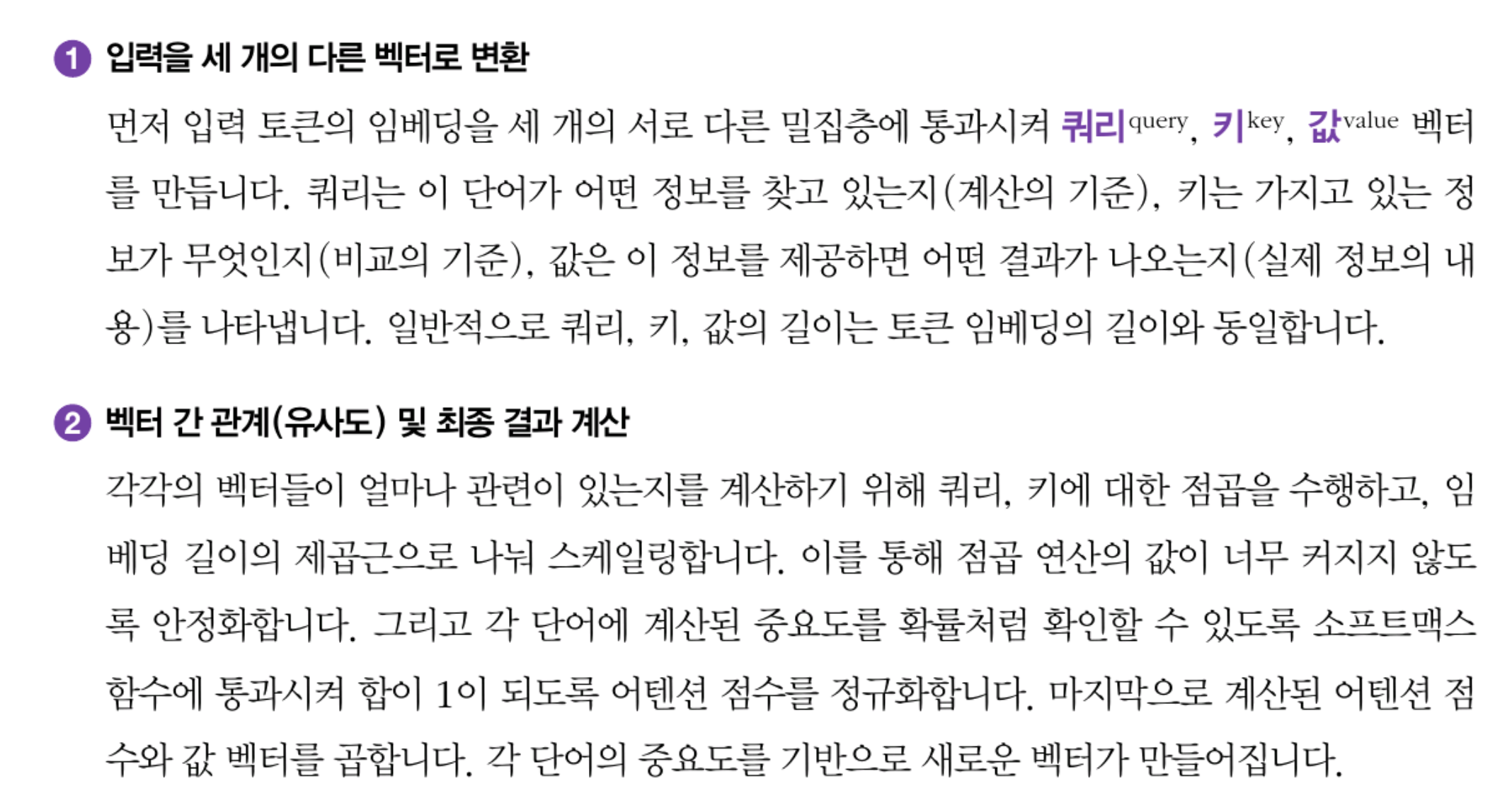

셀프어텐션돌려보기(이건 04-1번이지만 필요하다.

멀티헤드어텐션

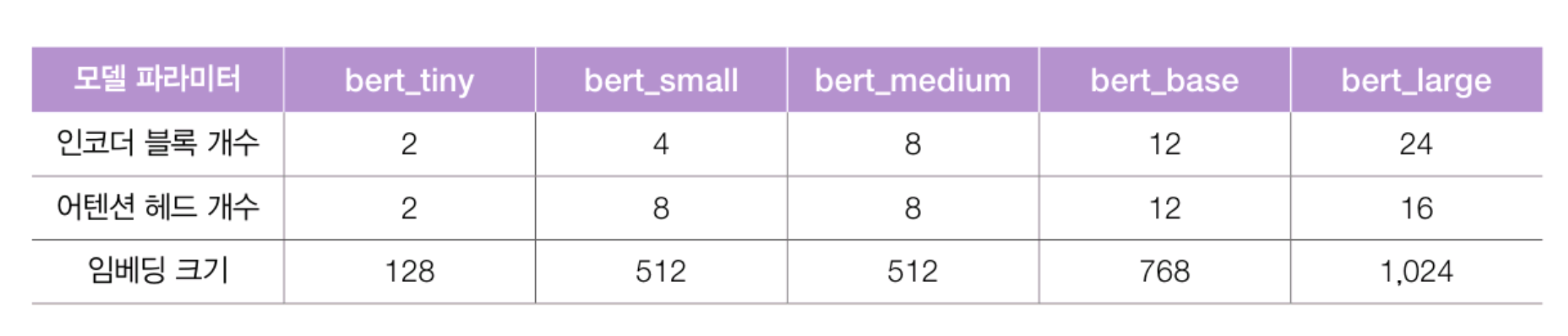

트랜스포머인코더 모델 이해하고 맹그러보쟈

내꺼는 A100선택 불가

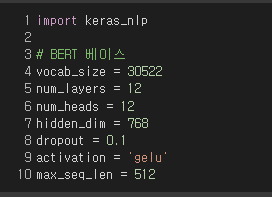

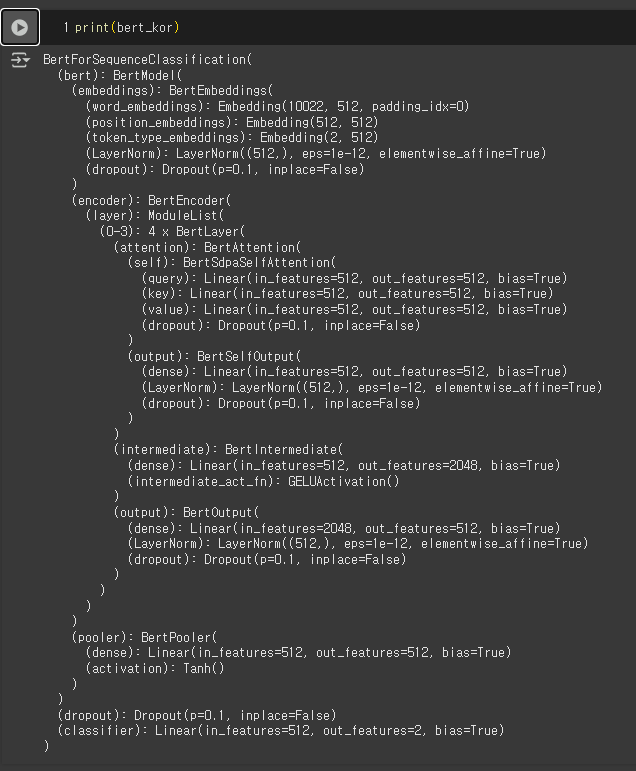

여튼 BERT 백본모델 맹글기

KerasNLP 임포트

bert_base 모델 만들기

......

파라미터수가 417MB가 넘음 ㄷㄷㄷ

본격적인 영화리뷰 텍스트 감성분류 시작

데이터셋 로드

트레인 테스트 셋

샘플하나 추출해서.

pandemonium

부정적 0

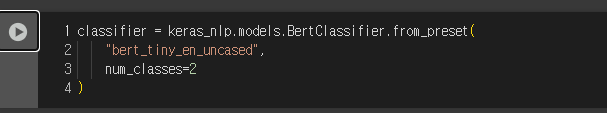

BERT모델 로드

출력구조 확인

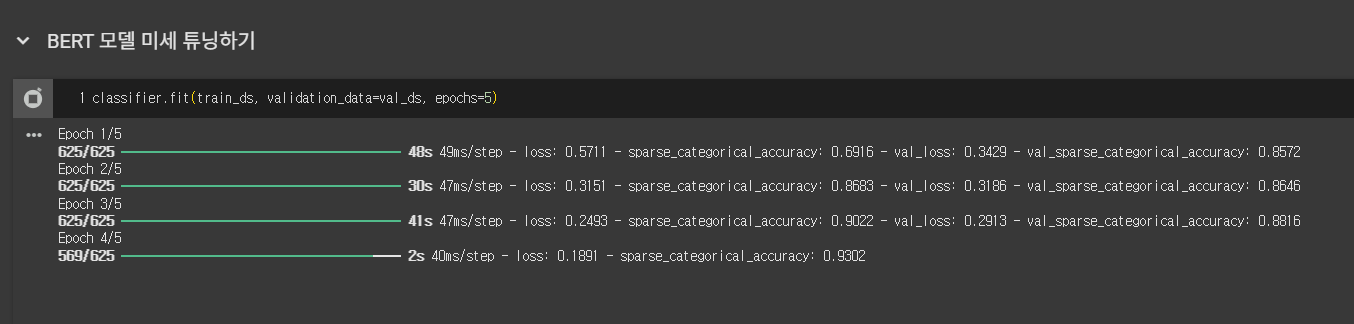

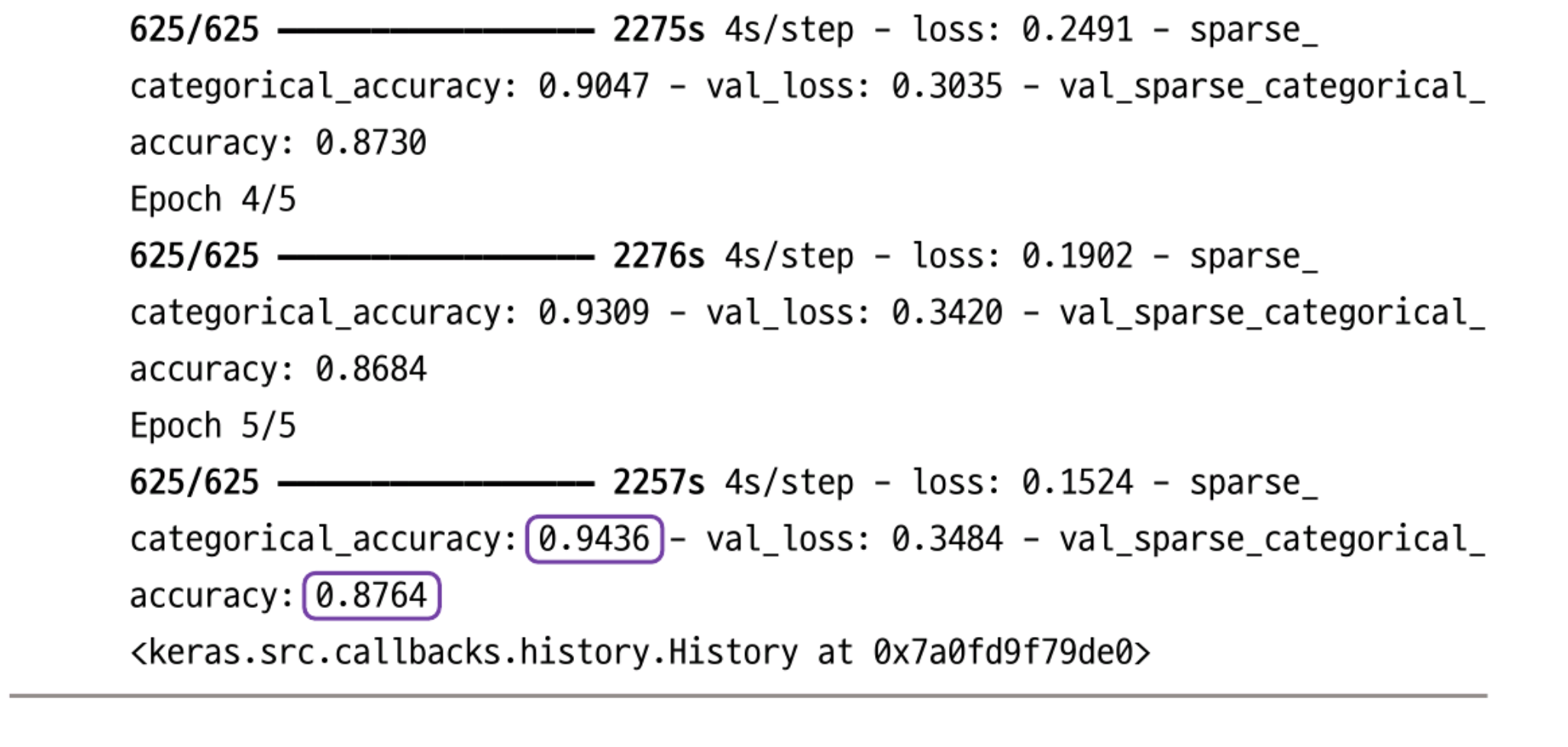

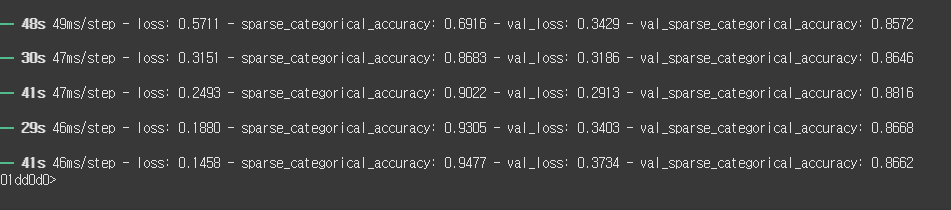

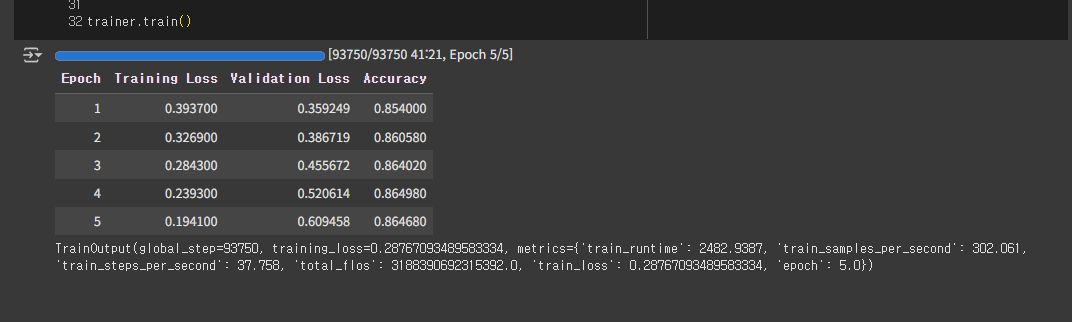

파인튜닝 가즈아~ 공포의 에포크 돌리기..

교재에서는 에포크다섯번만에 정확도 94.3

내꺼는 94.7~ 그러나검증세트 정확도에서 쵸큼 졌다.

이런식으로 쭈욱~~ 미션은 허깅페이스BERT모델로 분석후 결과캡쳐인데 아직 반도 못왔다.

아무래도 캡쳐는 여기까지만 하고 뒷부분으로 넘어가야 할듯

데이터셋 로드에 문제가 생긴다.

load_dataset 함수를 실행할 때 오류가 발생하여 nsmc 변수가 제대로 생성되지 않았다.

nsmc 대신 train_df를 사용하여 첫 번째 훈련 데이터의 'document' 열에 접근했다.

교재엔 안나오는

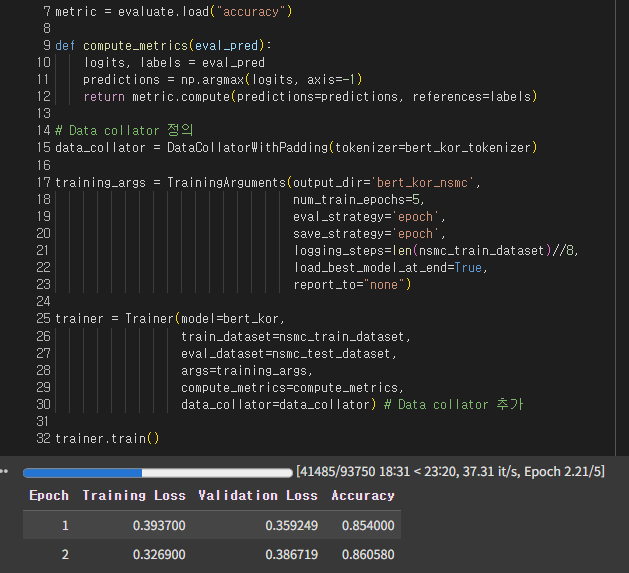

허깅페이스 트레이너에서 데이터 시퀀스 길이가 일관되지 않을때 나타나는 오류가 발생했다.

이를 해결하기 위해 트랜스포머라이브러리의 데이터콜렉터위드 패딩을 사용.

(잼미니가 알려줌)

인내심을 가지고...

1시간째..

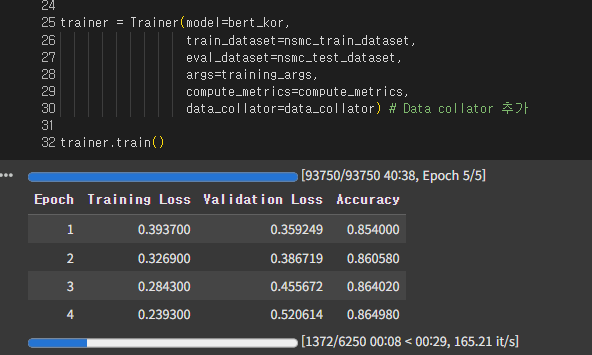

책과는 아주 다른 결과가 나오긴 했지만 그래도 결과가 나왔다는데 의의를 두겠다.

이상 14기 끗.

'혼공만딥' 카테고리의 다른 글

| [혼공학습단 14기] 혼자 만들면서 공부하는 딥러닝 완주 회고 (5) | 2025.08.19 |

|---|---|

| [혼만딥](혼공학습단14기) 5주차_Ch.03(03-3) 사전 훈련 모델로 피스타치오 품종 이미지 분류 실습 후 결과 캡처하기 (1) | 2025.08.10 |

| [혼만딥](혼공학습단14기) 4주차 Ch.03(03-1, 03-2) 고급 CNN모델과 전이학습으로 이미지 분류하기 (0) | 2025.07.29 |

| [혼만딥](혼공학습단14기) 3주차_2장 2. 강아지와 고양이 사진 분류 (1) | 2025.07.20 |

| [혼만딥](혼공학습단14기) 2주차_ 1장 3. 패션 상품 이미지 분류 (2) | 2025.07.13 |